人工智能伦理问题的核心争议点在于如何平衡人工智能的发展与人类伦理道德之间的关系。争议点包括数据隐私保护、算法公平性和透明度、责任归属以及机器决策的道德考量等方面。随着人工智能技术的快速发展,这些问题愈发凸显,亟待解决,以确保人工智能的应用符合人类的伦理道德标准。

本文目录导读:

随着科技的飞速发展,人工智能(AI)已逐渐渗透到我们生活的方方面面,从智能助手到自动驾驶汽车,从医疗诊断到金融交易,其应用场景日益广泛,随着人工智能技术的普及,其伦理问题也逐渐浮出水面,引发了社会各界的广泛关注与讨论,本文将探讨人工智能伦理问题的核心争议点,并寻求可能的解决之道。

数据隐私与安全问题

人工智能的发展离不开数据,而数据的收集和使用往往涉及到个人隐私,在人工智能的应用过程中,许多企业或个人在未经用户同意的情况下收集、使用甚至分享用户数据,严重侵犯了用户的隐私权,数据的泄露和滥用也是人工智能时代的一大安全隐患,如何保障数据隐私与安全成为人工智能伦理问题的首要争议点。

解决策略:

1、强化法律法规建设,明确数据收集、存储、使用等环节的规范与责任。

2、提高企业的数据安全意识,建立严格的数据管理制度。

3、鼓励企业研发数据安全技术,保障用户数据的安全与隐私。

责任与问责制问题

人工智能系统的决策往往基于大量数据及其算法,而这些决策结果可能产生严重的社会影响,当AI系统出现错误或过失时,如何界定责任成为一个棘手的问题,是追究设计者、开发者、使用者还是系统的责任?这在法律与伦理上均存在争议。

解决策略:

1、建立完善的人工智能监管体系,对AI系统的开发、应用与决策过程进行全程监控。

2、明确各方的责任边界,确保在出现问题时能够迅速追责。

3、鼓励企业建立内部审查机制,对AI系统的决策进行自查与纠错。

公平性与偏见问题

人工智能在训练过程中可能会受到数据偏见的影响,导致算法产生不公平的决策结果,这种不公平性可能导致某些群体受到歧视,引发社会不公,如何确保人工智能的公平性与无偏见性成为亟待解决的问题。

解决策略:

1、在数据收集阶段,确保数据的多样性与代表性,减少数据偏见。

2、在算法设计过程中,加强对算法的审查与评估,确保算法的公平性。

3、建立反馈机制,对AI系统的决策结果进行监督与调整,及时纠正偏见。

自主决策权问题

随着人工智能技术的发展,越来越多的决策任务被交给AI系统来完成,这些决策是否真正符合人类的意愿与需求?人类是否应该拥有对AI决策的否决权?这是人工智能伦理中不可忽视的问题。

解决策略:

1、赋予用户更多的选择权与参与权,让用户参与到AI决策的制定过程中。

2、建立人机协同决策机制,确保AI决策在人类的监督与指导下进行。

3、鼓励企业与公众就AI决策的透明度和可解释性进行公开讨论,增进互信。

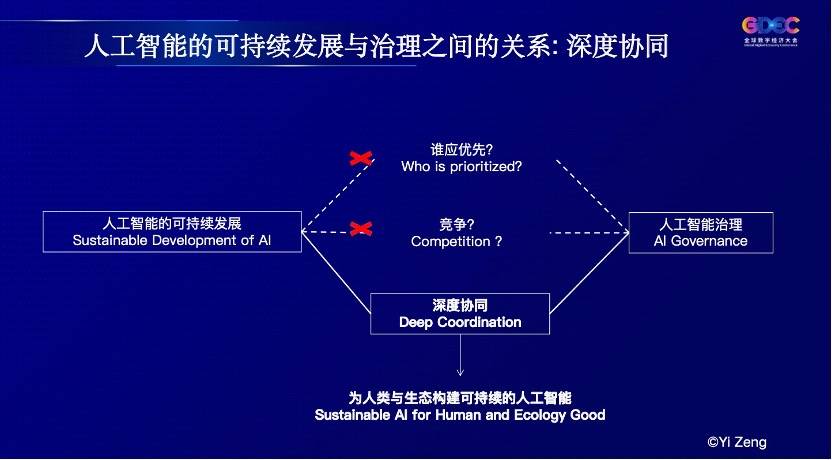

长远影响与可持续发展问题

人工智能的快速发展可能对社会、经济、环境等方面产生长远影响,如何在确保人工智能发展的同时实现可持续发展成为核心争议点之一。

解决策略:

1、加强人工智能对环境、社会、经济等方面的研究,预测其长远影响。

2、制定可持续发展指标,引导人工智能技术的绿色发展与应用。

3、鼓励跨界合作,整合各方资源共同应对人工智能带来的挑战。

人工智能伦理问题需要我们从数据隐私与安全、责任与问责制、公平性与偏见、自主决策权以及长远影响与可持续发展等方面进行深入探讨与解决,只有确保人工智能技术的发展符合伦理规范,才能更好地服务于人类社会,推动科技进步与社会和谐共生。

浙ICP备16014136号-1

浙ICP备16014136号-1

还没有评论,来说两句吧...